-

목차

기술이 앞서가는 시대일수록 윤리가 그 방향을 잡아주는 나침반이 됩니다

인공지능이 발전할수록 윤리는 더 절실해지는가

AI가 사람처럼 판단하고, 추천하고, 심지어 결정하는 세상이 되었습니다

하지만 이 과정에서 발생할 수 있는 차별, 편향, 책임 소재의 문제는 단순한 기술 문제가 아닙니다

바로 윤리라는 기준 없이는 제어할 수 없는 문제이기 때문입니다

AI의 결정, 누구의 책임인가

AI가 내린 결정으로 인해 불이익을 받은 사용자가 생겼다면

그 책임은 누구에게 있을까요? 개발자일까요, 사용자일까요, 혹은 기업일까요?AI는 스스로 책임지지 않습니다

결국 사람의 판단이 개입되어야 하며, 이 책임 구조를 명확히 규정하는 윤리 기준이 필요합니다

데이터 편향이 만든 불공정한 판단

AI는 데이터를 학습합니다

하지만 이 데이터에 이미 사회의 편견이나 불균형이 내포되어 있다면

AI는 그것을 그대로 반영하게 됩니다예를 들어, 채용 알고리즘이 특정 성별이나 인종을 배제한 사례는

AI의 문제라기보다는 데이터와 설계자의 윤리 의식 부재에서 비롯된 문제입니다

투명성과 설명 가능성의 중요성

AI가 내린 판단의 이유를 알 수 없다면

사람들은 그 결과를 신뢰하기 어렵습니다"왜 이런 결론이 나왔는지" 설명할 수 있는 투명성 확보는

AI 윤리의 핵심 원칙이며, 실제로 유럽연합에서는 '설명 가능성'을 법으로 요구하고 있습니다

공공 영역에서의 AI 사용, 더욱 엄격한 기준 필요

공공 서비스에 AI가 도입될수록 윤리 기준은 더 강화되어야 합니다

교육, 의료, 법률 분야에서의 AI 활용은

사람의 생명과 삶에 직접 영향을 미치므로, 최소한의 감시와 기준이 필수입니다적용 분야 윤리적 쟁점 필요 조치

의료 오진 가능성, 생명 결정 전문가의 최종 판단 유지 채용 성별·학력 편향 알고리즘 감시 위원회 구성 치안 얼굴인식 오판 개인정보 보호 기준 명확화

감정적 설득을 넘는 윤리 교육의 필요성

기술자와 정책 담당자, 사용자 모두에게

단순한 감정적 동의가 아닌 "구체적 윤리 원칙과 상황별 판단 기준"을 제공하는 교육이 필요합니다AI 윤리는 더 이상 선택이 아닌 필수 교양이며,

윤리 없는 기술은 불안과 혼란을 불러옵니다

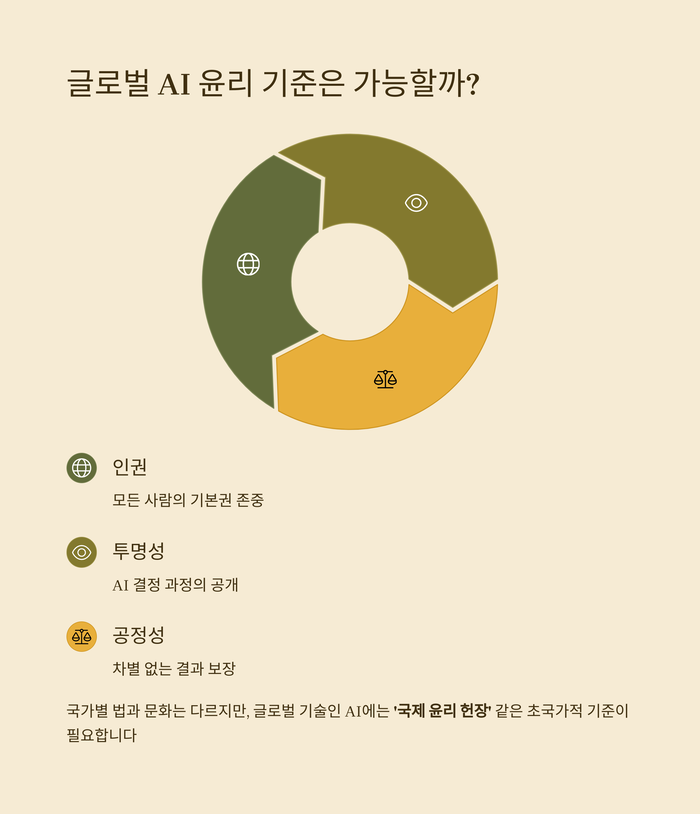

글로벌 윤리 기준은 가능한가

국가별로 법과 문화가 다르기 때문에

AI 윤리 기준도 제각각이 될 수밖에 없습니다하지만 글로벌 기술인 AI에는 통일된 기준이 필요합니다

'국제 윤리 헌장' 같은 초국가적 기준 마련 논의가 활발히 이루어지고 있으며

그 중심에는 인권, 투명성, 공정성이라는 3대 원칙이 있습니다

기술보다 앞서가는 윤리가 미래를 지킨다

AI는 단지 도구일 뿐입니다

그 도구를 어디에, 어떻게 쓰느냐는 결국 사람의 윤리 판단에 달려 있습니다기술이 아무리 발전해도

그 방향은 윤리가 정해야 하며, 윤리가 없는 AI는 결코 인류를 위한 기술이 될 수 없습니다

'IT & 테크' 카테고리의 다른 글

인공지능 스타트업이 위기를 돌파하며 살아남는 전략 (1) 2025.06.09 머신러닝 초보자들이 빠지기 쉬운 7가지 함정 (0) 2025.06.09 2025년 자율주행 스타트업, 투자 가치 높은 기업은 어디? (1) 2025.06.08 스마트 교통망이 만드는 자율주행 시대의 초석 (0) 2025.06.08 테슬라 FSD 최신 업데이트, 진짜 달라진 점은 무엇일까? (3) 2025.06.07

조은하루랑 님의 블로그

joy-today1 님의 블로그 입니다.